Nếu sitemap được ví như bản đồ giúp Google biết “nhà bạn có gì”, thì file robots.txt lại giống như tấm bảng chỉ dẫn ngoài cổng, cho biết “khu nào được vào, khu nào cấm cửa”. Đây là một công cụ SEO tuy đơn giản nhưng cực kỳ quan trọng, đặc biệt nếu bạn muốn kiểm soát cách Googlebot và các công cụ tìm kiếm khác thu thập dữ liệu trên website.

Tuy nhiên, với những bạn mới bước vào nghề SEO, khái niệm file robots.txt nghe vừa khô khan vừa khó hiểu. Đừng lo, trong bài viết này Guestpost.vn sẽ giúp bạn hiểu rõ: file robots.txt là gì, cách hoạt động, cách tạo và những sai lầm thường gặp. Mình sẽ lấy ví dụ đời thường để bạn dễ hình dung, đảm bảo đọc xong có thể áp dụng ngay cho website của mình.

File robots.txt là gì?

Định nghĩa dễ hiểu

File robots.txt là một tệp văn bản nhỏ đặt trong thư mục gốc của website. Nó chứa những “luật lệ” dành cho các bot tìm kiếm (như Googlebot, Bingbot…), quy định rõ:

- Những trang nào được phép thu thập dữ liệu.

- Những trang nào bị chặn không cho bot truy cập.

Ví dụ: Bạn có một cửa hàng offline. Khách hàng thì được vào khu trưng bày sản phẩm, nhưng “phòng kho” hay “phòng kế toán” thì chỉ nhân viên mới được vào. File robots.txt chính là tấm biển ghi rõ “khách hàng không vào khu vực kho” để Googlebot không lạc vào nơi không cần thiết.

Vị trí của file robots.txt

File này luôn phải đặt ở thư mục gốc của website, ví dụ:

https://www.example.com/robots.txt

Nếu bạn đặt ở thư mục con như /folder/robots.txt, bot sẽ không tìm thấy. Nói cách khác, file robots.txt chỉ có hiệu lực khi nằm ở đúng “cổng chính” của website.

Cách kiểm tra website có robots.txt chưa

Chỉ cần gõ vào trình duyệt:

https://tenmiencuaban.com/robots.txt

Nếu có file, bạn sẽ thấy nội dung hiển thị. Nếu không, trình duyệt báo lỗi 404.

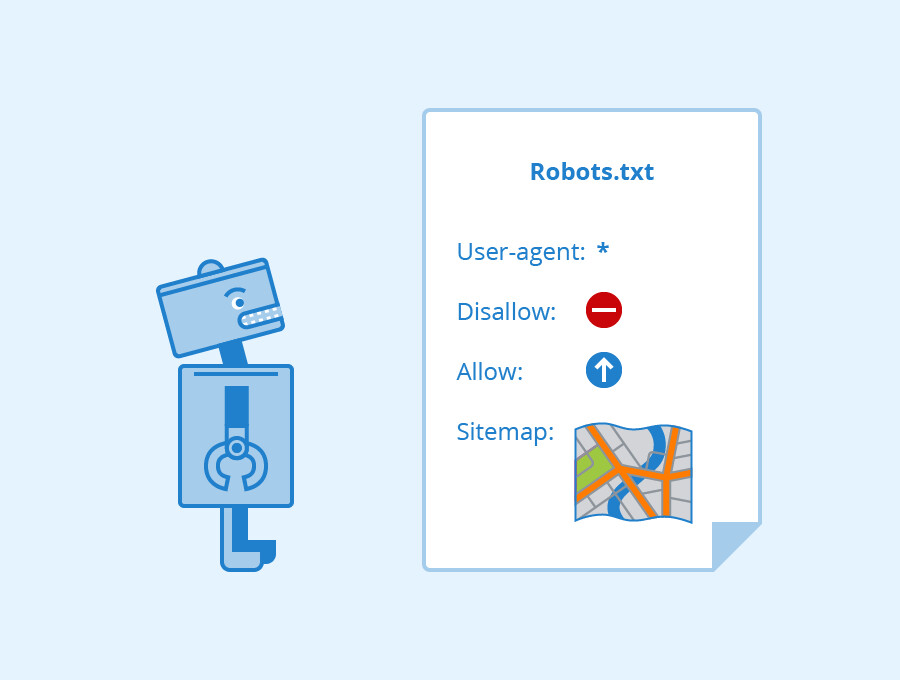

Cấu trúc chuẩn của file robots.txt

File robots.txt khá đơn giản, thường chỉ vài dòng. Các lệnh cơ bản gồm:

- User-agent: Chỉ định bot nào áp dụng quy tắc (Googlebot, Bingbot…). Nếu dùng dấu * thì áp dụng cho tất cả.

- Disallow: Đường dẫn bạn muốn chặn bot không thu thập.

- Allow: Cho phép bot truy cập một thư mục hoặc tệp cụ thể.

- Sitemap: Chỉ định vị trí file sitemap.xml.

Ví dụ một file robots.txt:

User-agent: Googlebot

Disallow: /admin/

Allow: /images/

Sitemap: https://example.com/sitemap.xml

Nghĩa là:

- Googlebot không được vào thư mục /admin/.

- Nhưng vẫn được phép thu thập thư mục /images/.

- Và Google biết sitemap nằm ở đâu.

Tác động của file robots.txt

Đối với website

- Điều phối lưu lượng bot: Tránh trường hợp bot “cày” quá nhiều trang cùng lúc gây nặng server.

- Ngăn thu thập trang không cần thiết: Ví dụ như trang quản trị, trang test, hoặc trang trùng lặp nội dung.

- Không phải cách ẩn nội dung: Nếu một trang bị chặn nhưng vẫn có website khác trỏ link về, Google vẫn có thể index URL (dù không đọc được nội dung).

Đối với hình ảnh, video, file tài nguyên

- Có thể chặn bot index hình ảnh hoặc video, ví dụ khi bạn không muốn ảnh sản phẩm bị copy.

- Tuy nhiên, không nên chặn các file CSS và JavaScript quan trọng, vì Google cần chúng để hiển thị trang chính xác.

Ví dụ đời thường: Giống như bạn cho phép khách vào xem cửa hàng, nhưng cấm họ xem bản thiết kế nội thất (CSS, JS). Nếu bạn “khóa” nhầm, khách sẽ nhìn thấy cửa hàng trong tình trạng xộc xệch, thiếu kệ hoặc sai màu.

Hạn chế của file robots.txt

Mặc dù hữu ích, robots.txt vẫn có những điểm yếu:

- Không phải bot nào cũng tuân thủ: Googlebot thì nghe lời, nhưng nhiều bot “lạ” (scraper, spam) có thể bỏ qua.

- Khác biệt cú pháp giữa các công cụ: Google, Bing hay Yandex có thể hiểu lệnh khác nhau.

- URL bị chặn vẫn có thể index: Nếu có link ngoài trỏ vào.

- Không đảm bảo bảo mật: Nếu muốn giấu tuyệt đối, bạn cần dùng mật khẩu, thẻ noindex hoặc xóa hẳn trang.

Hướng dẫn tạo robots.txt

1. Tạo thủ công

- Mở Notepad hoặc bất kỳ trình soạn thảo nào.

- Viết quy tắc theo cú pháp.

- Lưu với tên robots.txt.

- Upload lên thư mục gốc của website.

Ví dụ:

User-agent: *

Disallow: /private/

Allow: /

Sitemap: https://tenmiencuaban.com/sitemap.xml

2. Tạo trên WordPress

Nếu dùng WordPress, bạn có thể cài plugin như Yoast SEO, Rank Math, hoặc All in One SEO. Chúng sẽ tự tạo và cho bạn chỉnh sửa robots.txt ngay trong admin.

3. Dùng công cụ online

Nếu không rành kỹ thuật, bạn có thể dùng XML-sitemaps.com hoặc Screaming Frog để vừa quét website vừa tạo robots.txt và sitemap.

8 lỗi thường gặp khi dùng robots.txt

- Đặt sai vị trí – không để ở thư mục gốc.

- Lạm dụng ký tự đại diện (*, $) – dẫn đến chặn nhầm.

- Dùng noindex trong robots.txt – Google đã bỏ hỗ trợ từ 2019.

- Chặn nhầm CSS/JS – khiến Google hiểu sai giao diện.

- Không thêm sitemap – làm Google khó index.

- Cho bot vào site đang phát triển – có thể lộ nội dung chưa hoàn thiện.

- Dùng URL tuyệt đối thay vì đường dẫn tương đối.

- Dùng lệnh cũ không còn hỗ trợ.

Một số câu hỏi thường gặp

- Có thể dùng nhiều robots.txt không?

Không, mỗi website chỉ có 1 file robots.txt duy nhất. - Có chặn hoàn toàn một trang bằng robots.txt được không?

Không, bạn cần dùng thẻ meta noindex. - Khác nhau giữa robots.txt và sitemap.xml là gì?

Robots.txt để quản lý quyền truy cập bot, còn sitemap.xml để chỉ cho bot biết những URL quan trọng cần index.

Kết luận

File robots.txt tuy chỉ là một tệp văn bản nhỏ bé nhưng lại ảnh hưởng lớn đến SEO. Nó giúp bạn kiểm soát bot tìm kiếm, giảm tải cho server và tránh index những trang không cần thiết. Tuy nhiên, nếu sử dụng sai, nó cũng có thể khiến website bị mất index những trang quan trọng.

Vì vậy, hãy:

- Đặt file ở thư mục gốc.

- Viết quy tắc rõ ràng, không chặn nhầm CSS/JS.

- Luôn thêm link sitemap.

- Kiểm tra định kỳ bằng Google Search Console.

Nếu bạn mới bắt đầu SEO, hãy coi robots.txt như chiếc “chốt gác” ngoài cổng nhà mình. Quản lý chốt này tốt, Google sẽ vào nhà bạn một cách trật tự, còn khách hàng thì dễ dàng thấy được những gì bạn muốn hiển thị.

Xin chào! Tôi là Trịnh Văn Tuyển — một SEOer thực chiến với nhiều năm kinh nghiệm trong việc tối ưu hóa và phát triển hệ thống website hiệu quả.

Tôi đã tự tay xây dựng hơn 500 website từ con số 0, đưa chúng đạt đến hàng trăm nghìn lượt truy cập mỗi tháng thông qua quá trình làm việc tỉ mỉ: tự viết nội dung, tự đi backlink, tự thiết kế giao diện và tự triển khai cấu trúc Entity cho từng website.

Hiện tại, tôi là người sáng lập và điều hành Guestpost.vn — nền tảng hàng đầu tại Việt Nam chuyên cung cấp dịch vụ guest post chất lượng cao, giúp doanh nghiệp và cá nhân xây dựng thương hiệu vững chắc trên môi trường số.